Die beiden Forscher Granit Luzhnica und Eduardo Veas vom Know-Center gingen Methoden der Optimierung von vibrotaktil codierten Nachrichten auf den Grund. Die beiden Papers mit den Ergebnissen wurden nun auf den hochrangigen Konferenzen „CHI Conference on Human Factors in Computing Systems Proceedings“ (CORE A*) und “ACM Transactions on Interactive Intelligent Systems” (CORE A) präsentiert.

Traditionell wurde die Wahrnehmung von Informationen über die Haut für sehbehinderte Personen angewendet. Mit unseren tragbaren und mobilen Geräten findet sie aber mehr und mehr Anwendung unter Benutzern mit normalem Sehvermögen. Die primären Feedback-Modalitäten von Wearables-Geräten sind aktuell hauptsächlich visuell und akustisch, das heißt: Obwohl viele der Geräte vibrotaktile Fähigkeiten beinhalten, dient diese nur der Unterstützung von visuellen Interaktionen. Dabei liegt in der vibrotaktilen Rückkopplung ein großes Potenzial, reichhaltige Informationen zu übertragen, ohne dass diese durch Gehör- oder Sichtkanäle wahrgenommen werden müssen.

Granit Luzhnica und Eduardo Veas aus dem Knowledge Vizualisation Team des Know-Centers in Graz haben sich in zwei Studien diesem Thema gewidmet. „Optimising Encoding for Vibrotactile Skin Reading” präsentiert und evaluiert Methoden wie vibrotaktil codierte Informationen wie Buchstaben und Wörter verbessert wahrgenommen werden können.

Das Paper „Background Perception and Comprehension of Symbols Conveyed through Vibrotactile Wearable Displays“ stellt eine Nutzerstudie vor, die sich mit der vibrotaktilen Informationsübertragung beschäftigt, während gleichzeitig andere aufmerksamkeitsfordernde Aufgaben ausgeführt werden. Das Ergebnis zeigt, dass Benutzer vibrotaktil codierte Nachrichten im Hintergrund sehr genau verstehen konnten und parallel ausgeführte Tasks die Leistung nicht beeinträchtigten. Die aus den Arbeiten gewonnenen Erkenntnisse können der Grundlage für die weitere Untersuchung des Verständnisses von Textinformationen in den Bereichen “Hintergrundübertragung durch tragbare vibrotaktile Displays” dienen.

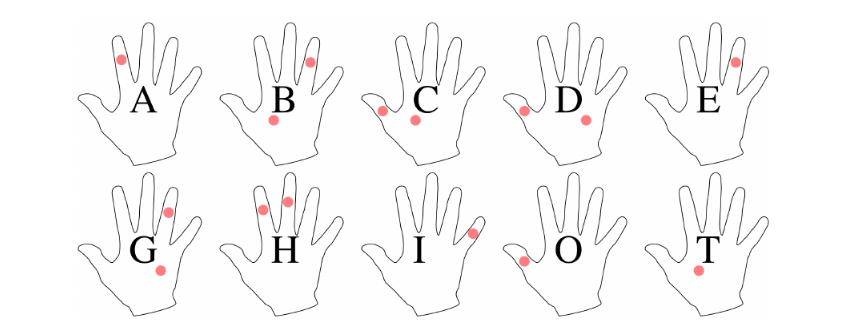

Die Dekodierung der Buchstaben, verwendet in der Studie „Background Perception and Comprehension of Symbols Conveyed through Vibrotactile Wearable Displays“

Literatur:

Luzhnica, Granit & Veas, Eduardo. (2019). Optimising Encoding for Vibrotactile Skin Reading.

Conference: CHI Conference on Human Factors in Computing Systems Proceedings (CHI 2019)

Luzhnica, Granit & Veas, Eduardo. (2019). Background Perception and Comprehension of Symbols Conveyed through Vibrotactile Wearable Displays.

Conference: ACM Intelligent User Interfaces (IUI 2019)